Nvidia olakšava pokretanje velikog jezičnog modela (engl. LLM) na vašem vlastitom Windows PC-ju.

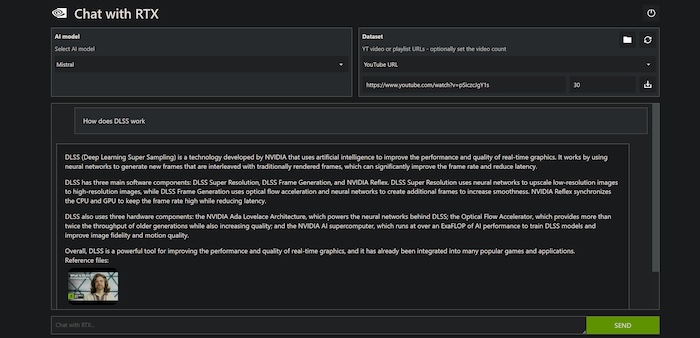

Nvidia je prije par dana pustila ranu verziju “Chata s RTX-om” (Chat with RTX), demo aplikaciju koja vam omogućuje pokretanje osobnog AI chatbota na vašem PC-ju. Možete mu davati YouTube videozapise i vlastite dokumente kako biste stvorili sažetke i dobili relevantne odgovore na temelju vaših vlastitih podataka. Sve to radi lokalno na PC-ju, a sve što vam treba je GPU serije RTX 30 ili 40 s najmanje 8GB VRAM-a.

Kratko smo testirali Chat s RTX-om, i iako je aplikacija malo ‘nedovršena’, već sada možemo vidjeti da će ovo biti vrijedan alat za istraživanje podataka (npr. za novinare) za bilo koga tko treba analizirati (veću) kolekciju dokumenata.

Analiza videozapisa

Chat s RTX-om može obrađivati YouTube videozapise, pa samo unesete URL do videa i chatbot vam omogućuje pretraživanje transkripata ili vam može dati sažetak cijelog videa. Ovo nam se činilo idealnim za pretraživanje video podcastova, posebice ako traju dugo i želite pogledati (ili pročitati) samo dio istoga.

Ovaj Chatbot još nije savršen jer smo probali naći određene rečenice ili riječi unutar određenih video zapisa i nismo ih uvijek dobili. Ono što želimo reći je – alat ima ogroman potencijal ali je demo izdanje još uvijek “bugovito”. Ali to nije razlog da ga ne koristite ili ne isprobate.

Analiza dokumenata

Također smo ga isprobali koristiti za pregledavanje PDF-ova i provjeru podataka. Copilot, vlastiti sustav tvrtke Microsoft, ne obrađuje dobro PDF-ove unutar Worda, ali Nvidijin “Chat with RTX” nije imao problema s izvlačenjem svih ključnih informacija. Odgovori su također gotovo trenutačni, bez kašnjenja koje obično vidite prilikom korištenja cloud-based chatbotova kao što je ChatGPT ili Copilot chatbot.

Veliki nedostatak ovog chatbota je što zaista djeluje kao rani programerski demo ili “alpha verzija”. Chat s RTX-om u osnovi instalira web poslužitelj i Python instancu na vašem računalu, koja zatim koristi Mistral ili Llama 2 modele za pretraživanje podataka koje mu dajete. Zatim koristi Nvidijine Tensor jezgre na RTX GPU-u kako bi ubrzao vaše upite.

Instalacija na PC

Instalacija Chata s RTX-om, na računalu pokretanom procesorom Intel Core i9-14900K i RTX 4090 GPU-om, trajala je oko 30 minuta. Aplikacija zauzima gotovo 40 GB prostora, a Python instanca koristi oko 3 GB RAM-a od raspoloživih 32 GB (na dotičnom računalu). Nakon što se pokrene, pristupate Chatu s RTX-om putem web preglednika, dok ‘naredbeni redak’ (engl. command prompt) pokreće u pozadini ispisujući što se obrađuje i eventualne kodove grešaka.

Nvidia ovo ne nudi kao gotovu aplikaciju koju bi svi vlasnici RTX-a trebali odmah preuzeti i instalirati. Postoji nekoliko poznatih problema i ograničenja, uključujući to da izvor atribucije nije uvijek točan. Uz to, ako mu date ogromne količine podataka (op.a. preko 10-15 tisuća dokumenata), aplikacija se zna srušiti i morate početi ispočetka.

Chat s RTX-om također ne pamti kontekst, pa se ne mogu postavljati dodatna pitanja na temelju konteksta prethodnog pitanja. Također stvara JSON datoteke unutar mapa koje ga tražite da indeksira, pa ne bih preporučili korištenje ovoga na cijelom mapi “Dokumenti” u sustavu Windows.

Ipak, ovo što je Nvidia isporučila i pokazala, uopće nije loše. Posebice za prvu verziju ili iteraciju, ako želite. Chat with RTX pokazuje obećanje onoga što AI chatbot može raditi lokalno na vašem PC-ju u budućnosti, posebno ako se ne želite pretplatiti na usluge poput Copilot Proa ili ChatGPT Plusa samo da biste analizirali svoje osobne datoteke.

Piše: Boris Plavljanić