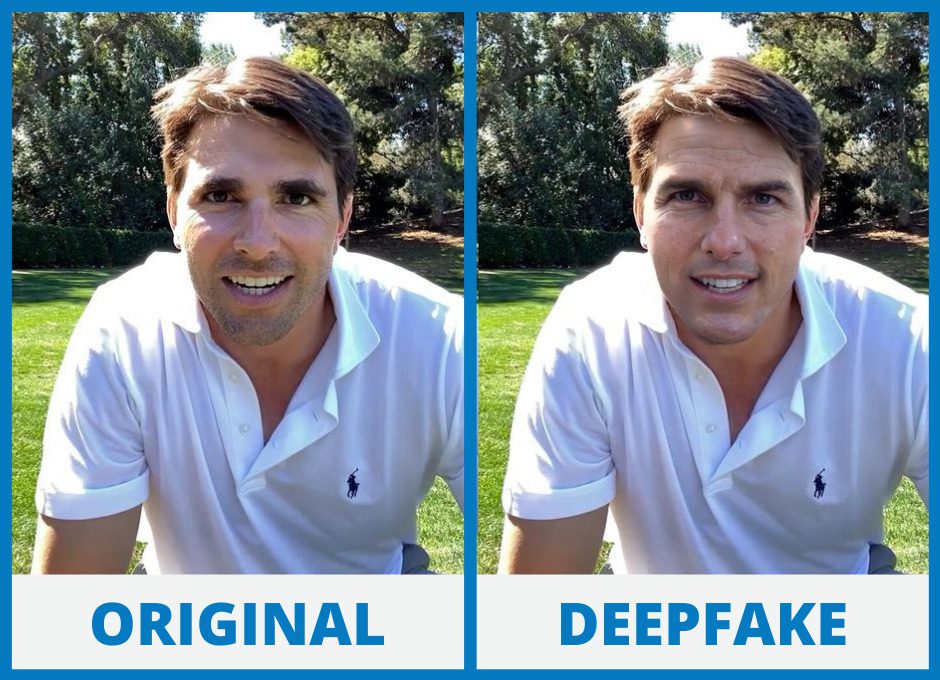

Vjerojatno ste i sami, tijekom prelistavanja različitih sadržaja, a samim time i fotografija, i sami primijetili nekoliko njih koje je generirala umjetna inteligencija. Možda ste za neke fotografije mislili da su autentične, da su ”prave”, no zapravo to nisu bile, ali vi to niste znali.

Možda ste i povjerovali u neke medijske natpise i objave na društvenim mrežama baš zbog tih umjetno generiranih fotografija, koje su među, kako stručnjacima tako i laicima, poznate kao ”deepfake”. Korisnici koji su duže vremena ”uronjeni” u svijet generativne umjetne inteligencije, malo će lakše primijetiti fotografiju ili sliku koju je kreirala umjetna inteligencija, budući da i za prepoznavanje takvih lažnih fotografija postoji odgovarajuća, tehnologija.

OpenAI počeo obraćati sve veću pozornost na poplavu ”deepfake” fotografija, kojih je na internetu sve više

No, kako tehnologija razvoja ”deepfake” fotografija postaje sve bolja i bolja, s vremenom će biti sve teže za odgonetnuti koja je fotografija autentična, a koja je lažna. Ne bi li riješio taj problem, tvrtka OpenAI, inače tvrtka koja je zaslužna za razvoj alata koji koristi umjetnu inteligenciju, ChatGPT, razvija nove metode za praćenje slika generiranih umjetnom inteligencijom i dokazivanje što jest, a što nije umjetno generirano.

Prema objavi koja je osvanula na blogu, nove predložene metode OpenAI-ja odnose se na dodavanje ”vodenog žiga”’, koji će biti otporan na neovlašteno korištenje. Taj poboljšani, vodeni žig trebao bi sadržaj označiti nevidljivim ‘naljepnicama’. To u prijevodu znači, ako je slika generirana OpenAI-jevim DALL-E generatorom, klasifikator će je označiti, čak i ako slika je iskrivljena ili zasićena.

U objavi koja stoji na blogu piše i da bi novi alat trebao imati oko 98% točnosti pri uočavanju fotografija, koje su generirane uz pomoć DALL-E-a. No, označit će samo 5-10% fotografija, koje su kreirane drugim generatorima, kao što su Midjourney ili Adobe Firefly. To znači da iako je alat izvrstan je za fotografije koje su kreirane od strane OpenAI-evih alata, neće biti tako dobar za bilo što, što nije kreirao OpenAI.

Iako možda sve ovo ne izgleda tako zadivljujuće kao što je zvučalo da bi moglo biti, ovo je ipak pozitivan pokazatelj, koji jasno pokazuje da je OpenAI počeo obraćati veliku pozornost na sve veći broj ”deepfake” fotografija, koje su kreirane uz pomoć alata umjetne inteligencije, a koje je kako vrijeme prolazi sve teže za razlikovati, jer su alati koji se koriste za kreiranje istih, sve napredniji.

Kada se sve zbroji i oduzme, možda se to nekima ne čini kao velika stvar, i možda OpenAI ne bi trebao obraćati pozornost i trošiti resurse na detekciju ”deepfake” fotografija. Istina je da su mnoge takve fotografije samo ”meme-ovi” i da su stoga poprilično bezopasne, barem zasad. No iako ovo stoji, postoji i negativna strana ”deepfake” političara.

Zahvaljujući različitim alatima, ”deepfake” fotografije mogu se koristiti u medijima za oblikovanje javnog mišljenja, što bi pak moglo dovesti do širenja dezinformacija te nastanka različitih teorija i scenarija. Vidjet ćemo kako će OpenAI razvijati svoju novu tehnologiju i u kojem će to smjeru ići u budućnosti.

Piše: Alan Milić